volatile 是如何保证可见性和有序性的?

一则或许对你有用的小广告

欢迎 加入小哈的星球 ,你将获得: 专属的项目实战(已更新的所有项目都能学习) / 1v1 提问 / Java 学习路线 / 学习打卡 / 每月赠书 / 社群讨论

- 新开坑项目: 《Spring AI 项目实战(问答机器人、RAG 增强检索、联网搜索)》 正在持续爆肝中,基于

Spring AI + Spring Boot3.x + JDK 21..., 点击查看; - 《从零手撸:仿小红书(微服务架构)》 已完结,基于

Spring Cloud Alibaba + Spring Boot3.x + JDK 17..., 点击查看项目介绍; 演示链接: http://116.62.199.48:7070/; - 《从零手撸:前后端分离博客项目(全栈开发)》 2 期已完结,演示链接: http://116.62.199.48/

面试考察点

-

JMM 理解深度:面试官不仅仅是想知道 "内存屏障" 这四个字,更是想确认你是否理解 Java 内存模型的主内存-工作内存交互机制,以及

volatile在这个模型中扮演的角色。 -

硬件层面的认知:能否从 CPU 缓存一致性、指令重排序、内存屏障等硬件层面解释

volatile的原理,是区分 "背过八股" 和 "真正理解" 的分水岭。 -

happens-before 规则:这是 JMM 的核心概念,考察你是否掌握

volatile变量的 happens-before 语义,以及如何用这套规则来推理并发程序的正确性。

核心答案

volatile 通过两套机制分别保证可见性和有序性:

| 保证的特性 | 实现机制 | 核心原理 |

|---|---|---|

| 可见性 | JMM 的主内存-工作内存协议 + CPU 缓存一致性协议(MESI) | 写操作立刻刷回主内存,读操作直接从主内存取,并使其他 CPU 缓存行失效 |

| 有序性 | 内存屏障(Memory Barrier) | 编译器和 CPU 看到屏障后,不会把屏障前后的指令重排序 |

两者统一的底层实现是:JVM 在 volatile 变量的读写操作前后插入特定类型的内存屏障。

深度解析

一、可见性——从 JMM 说起

先理解问题的根源:为什么多线程之间会 "看不到" 对方修改的值?

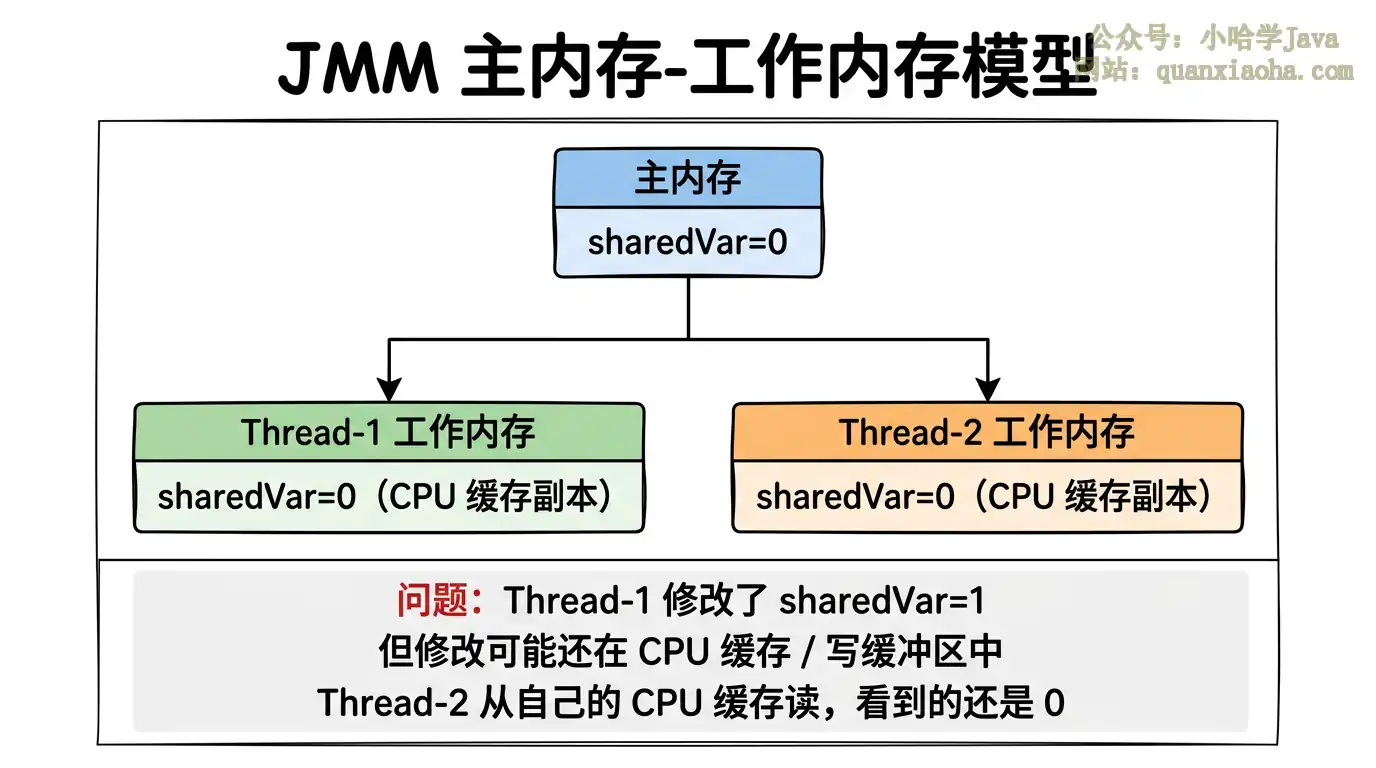

上图展示了 Java 内存模型的核心结构。JMM 规定每个线程有自己的工作内存(对应 CPU 缓存 / 寄存器),所有共享变量存储在主内存中。线程对变量的读写操作必须经过工作内存,不能直接操作主内存。这就导致了可见性问题——一个线程在工作内存中修改了值,另一个线程可能还在读自己工作内存中的旧值。

volatile 怎么解决? 它对读写操作加了特殊约束:

- 写操作:修改后立刻从工作内存刷新到主内存(对应 CPU 层面,通过缓存一致性协议使其他 CPU 中该变量的缓存行失效)

- 读操作:每次都从主内存重新加载最新值(不从工作内存的缓存副本读)

底层依赖 CPU 的缓存一致性协议(最典型的是 MESI 协议)。当一个 CPU 修改了 volatile 变量,硬件层面会发出 "总线锁 / 缓存行锁" 信号,通知其他 CPU 将该变量对应的缓存行标记为 "无效"。其他 CPU 再读这个变量时,发现缓存行失效了,就会去主内存重新加载。

// 可见性示例

public class VisibilityDemo {

// 不加 volatile,子线程可能永远看不到 running 变成 false

private static volatile boolean running = true;

public static void main(String[] args) throws InterruptedException {

new Thread(() -> {

int count = 0;

while (running) { // volatile 保证读到主内存的最新值

count++;

}

System.out.println("线程停止,count=" + count);

}).start();

Thread.sleep(1000);

running = false; // volatile 保证立刻刷回主内存

// 如果不加 volatile,子线程可能永远不停止(JIT 优化导致死循环)

}

}

二、有序性——内存屏障

有序性问题的根源是 指令重排序。编译器和 CPU 为了提高执行效率,会在不影响单线程执行结果的前提下,对指令的执行顺序进行重新排列。但在多线程环境下,这种重排序可能导致其他线程看到 "错误" 的执行顺序。

经典案例:DCL 单例模式

public class Singleton {

private static volatile Singleton instance; // 必须 volatile

public static Singleton getInstance() {

if (instance == null) {

synchronized (Singleton.class) {

if (instance == null) {

instance = new Singleton(); // 这行会被重排序吗?

}

}

}

return instance;

}

}

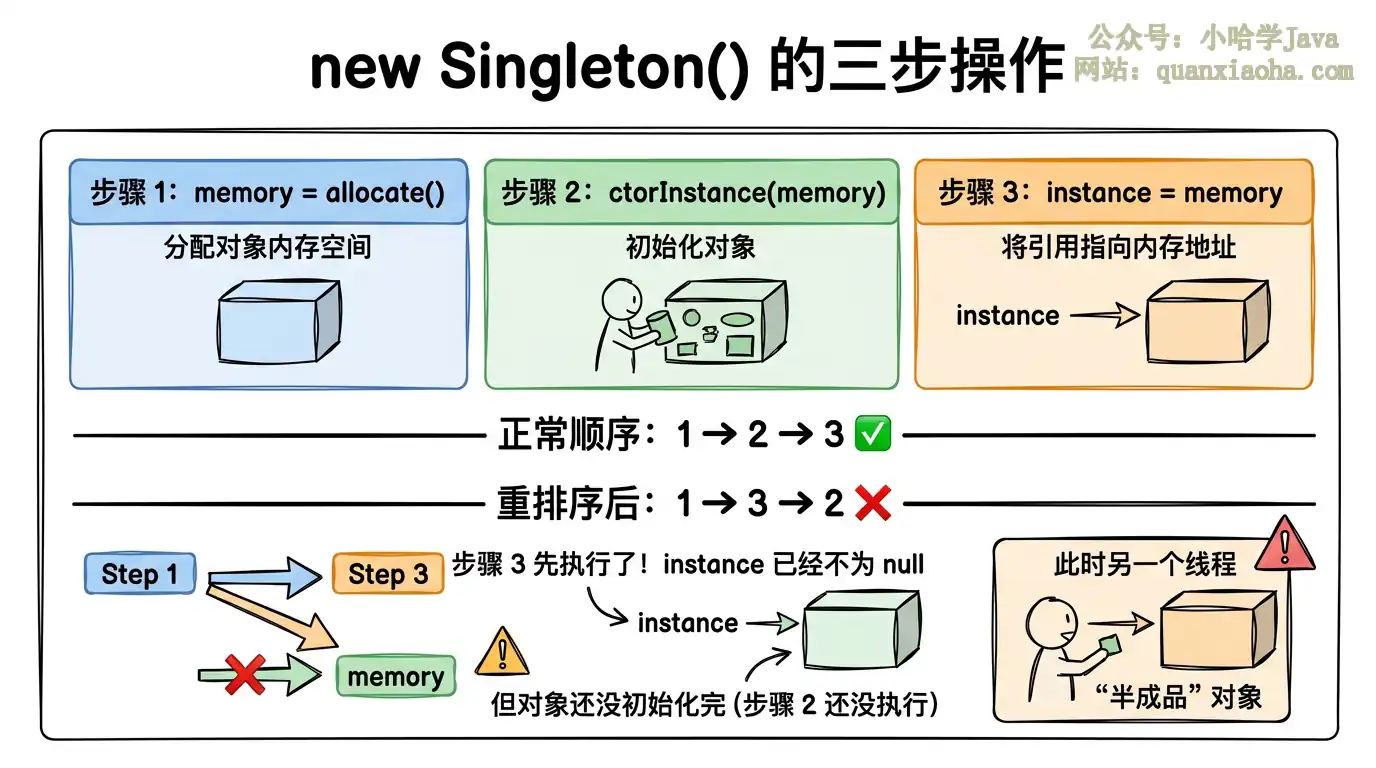

instance = new Singleton() 这行代码在字节码层面分三步:

上图展示了指令重排序导致的典型问题。正常情况下,对象创建应该按 1→2→3 的顺序执行。但编译器或 CPU 可能将步骤 2 和 3 重排序(因为从单线程角度看,2 和 3 之间没有数据依赖)。重排序后变成 1→3→2,此时步骤 3 执行完,instance 已经不为 null,但对象还没初始化。如果另一个线程在这时访问 instance,就会拿到一个半初始化的对象,导致 NPE 或其他异常。

volatile 通过内存屏障来禁止这种重排序。

三、内存屏障——volatile 的核心实现

内存屏障(Memory Barrier / Fence)是一条 CPU 指令,它的作用是告诉编译器和 CPU:屏障前后的指令不能跨过屏障重排序。

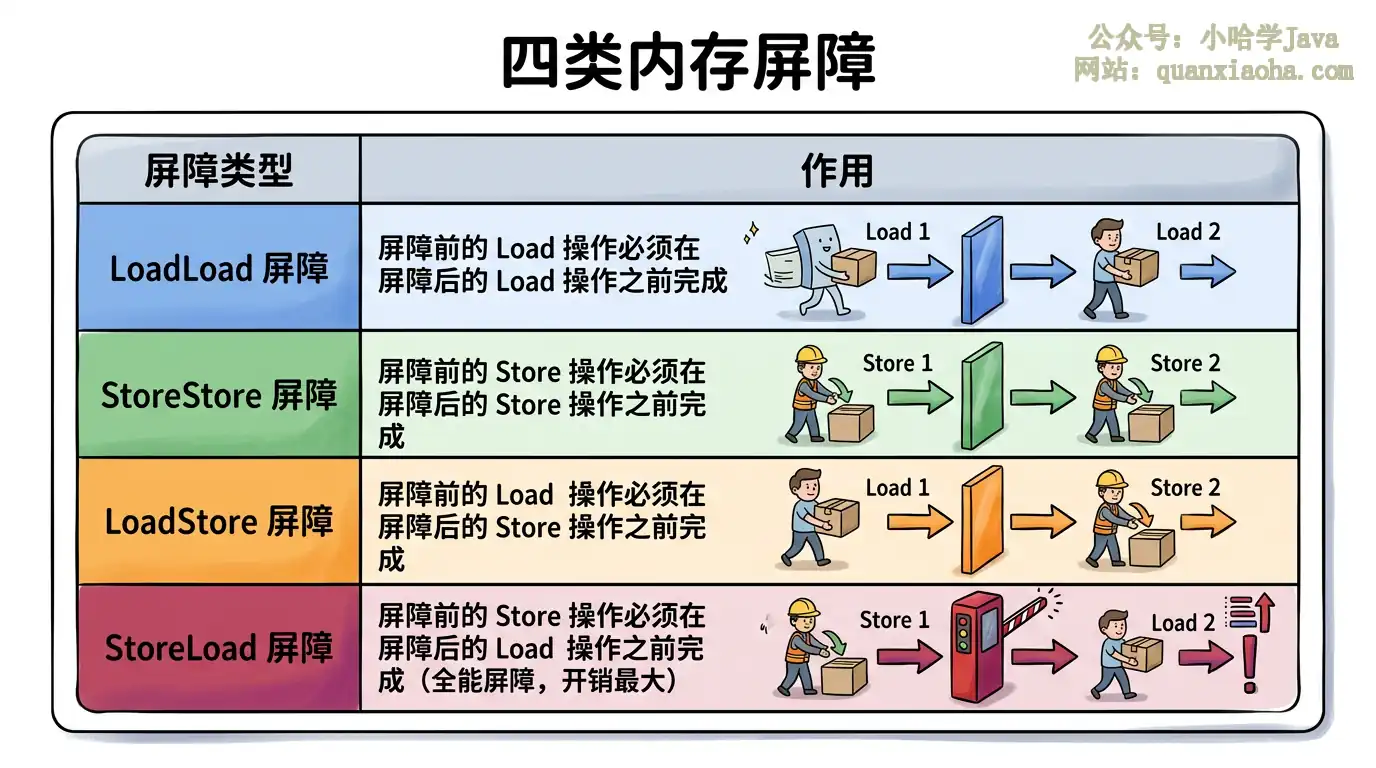

JMM 定义了四类内存屏障:

JVM 在 volatile 变量的读写操作前后插入屏障的策略如下:

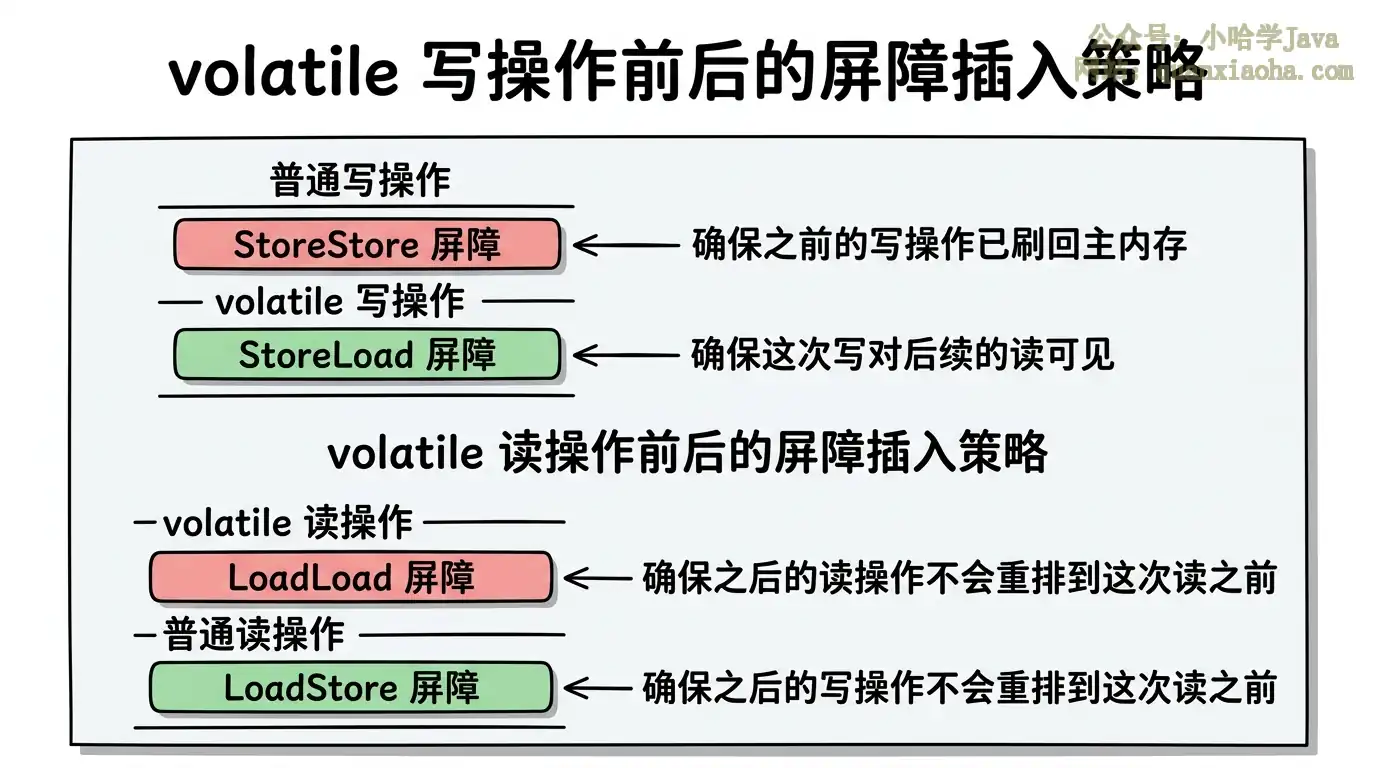

上方的图示展示了 volatile 读写操作的屏障插入策略,总结一下就是:

- volatile 写之前:插入

StoreStore屏障,保证前面的普通写操作已经刷新到主内存,不会和volatile写重排序 - volatile 写之后:插入

StoreLoad屏障,保证volatile写的结果对后续所有读操作可见(这是最重的屏障) - volatile 读之后:插入

LoadLoad+LoadStore屏障,保证volatile读之后的读写操作不会被重排到volatile读之前

这套屏障策略从两个维度同时生效:

- 可见性维度:强制读写走主内存,绕过 CPU 缓存的 "偷懒" 行为

- 有序性维度:屏障禁止了跨屏障的指令重排序,保证其他线程看到的操作顺序和代码顺序一致

四、从 happens-before 角度理解

JMM 用 happens-before 规则来形式化地描述 "什么操作的结果对什么操作可见"。volatile 的 happens-before 规则是:

对一个

volatile变量的写操作,happens-before 于后续对这个volatile变量的读操作。

// 线程 A

int a = 1; // 普通写

volatile boolean flag = true; // volatile 写

// 线程 B

if (flag) { // volatile 读

int b = a; // 此时 b 一定能看到 a=1

}

为什么?因为 volatile 写之前的所有操作(包括 a=1)都会被 "推" 到 volatile 写之前完成(StoreStore 屏障保证),而 volatile 读之后的所有操作不会被重排到 volatile 读之前(LoadLoad 屏障保证)。所以线程 B 读到 flag=true 之后,一定也能看到 a=1。

这就是 volatile 不仅仅保证自身可见性,还能 "顺带" 保证之前所有写操作可见性的原因。

面试高频追问

-

追问一:volatile 和 synchronized 在可见性上的区别?

volatile是轻量级的可见性保证,通过内存屏障实现,不会阻塞线程;synchronized是重量级的,通过 Monitor 锁实现,进入同步块时从主内存刷新,退出时刷回主内存。synchronized既保证可见性又保证原子性,volatile只保证可见性和有序性。 -

追问二:为什么 StoreLoad 屏障开销最大?

StoreLoad屏障需要把写缓冲区(Store Buffer)中的所有数据刷新到主内存,同时使其他 CPU 的缓存行失效。这个操作相当于一个 "全量同步",开销接近甚至等于一个锁操作。这也是为什么volatile写比普通写慢很多的原因。 -

追问三:volatile 能不能保证 long 和 double 的原子性?

这是个有趣的细节。JMM 规定

long和double的普通读写不是原子的(64 位在 32 位 JVM 上可能分两次 32 位操作)。但volatile修饰的long和double的读写是原子的(JLS 明确规定)。不过这个原子性仅限于单次读/写,复合操作(如+=)依然不保证。

常见面试变体

- "volatile 的底层实现原理是什么?"

- "什么是内存屏障?volatile 是怎么用内存屏障的?"

- "volatile 和 synchronized 的区别?"

- "什么是 happens-before?volatile 的 happens-before 语义是什么?"

记忆口诀

可见性:写刷主内存,读从主内存取,缓存行失效通知到所有 CPU。有序性:四种屏障插在读写前后,禁止跨屏障重排序。一句话:内存屏障是 volatile 的灵魂。

总结

volatile 通过两个层面同时工作:可见性靠 JMM 的主内存-工作内存协议 + CPU 缓存一致性协议,保证写立刻刷回、读从主内存取;有序性靠内存屏障,禁止编译器和 CPU 对 volatile 前后的指令重排序。两者统一的底层机制就是 JVM 在 volatile 读写前后插入的四类内存屏障。面试中把这套 "JMM → 缓存一致性 → 内存屏障 → happens-before" 的链路讲清楚,面试官基本不会再追问了。