多线程上下文切换是什么意思?

一则或许对你有用的小广告

欢迎 加入小哈的星球 ,你将获得: 专属的项目实战(已更新的所有项目都能学习) / 1v1 提问 / Java 学习路线 / 学习打卡 / 每月赠书 / 社群讨论

- 新开坑项目: 《Spring AI 项目实战(问答机器人、RAG 增强检索、联网搜索)》 正在持续爆肝中,基于

Spring AI + Spring Boot3.x + JDK 21..., 点击查看; - 《从零手撸:仿小红书(微服务架构)》 已完结,基于

Spring Cloud Alibaba + Spring Boot3.x + JDK 17..., 点击查看项目介绍; 演示链接: http://116.62.199.48:7070/; - 《从零手撸:前后端分离博客项目(全栈开发)》 2 期已完结,演示链接: http://116.62.199.48/

面试考察点

-

底层原理理解:面试官不仅仅是想知道 "切换" 这两个字,更是想考察你是否理解操作系统层面的 CPU 时间片调度机制,以及切换过程中到底保存了什么、恢复了什么。

-

性能意识:是否清楚上下文切换是有代价的,能否从性能角度解释 "为什么线程不是越多越好",这体现了你对高并发调优的理解。

-

排查能力:能否识别上下文切换过高的线上问题,知道用什么工具、看什么指标,这是区分 "背概念" 和 "有实战经验" 的关键。

核心答案

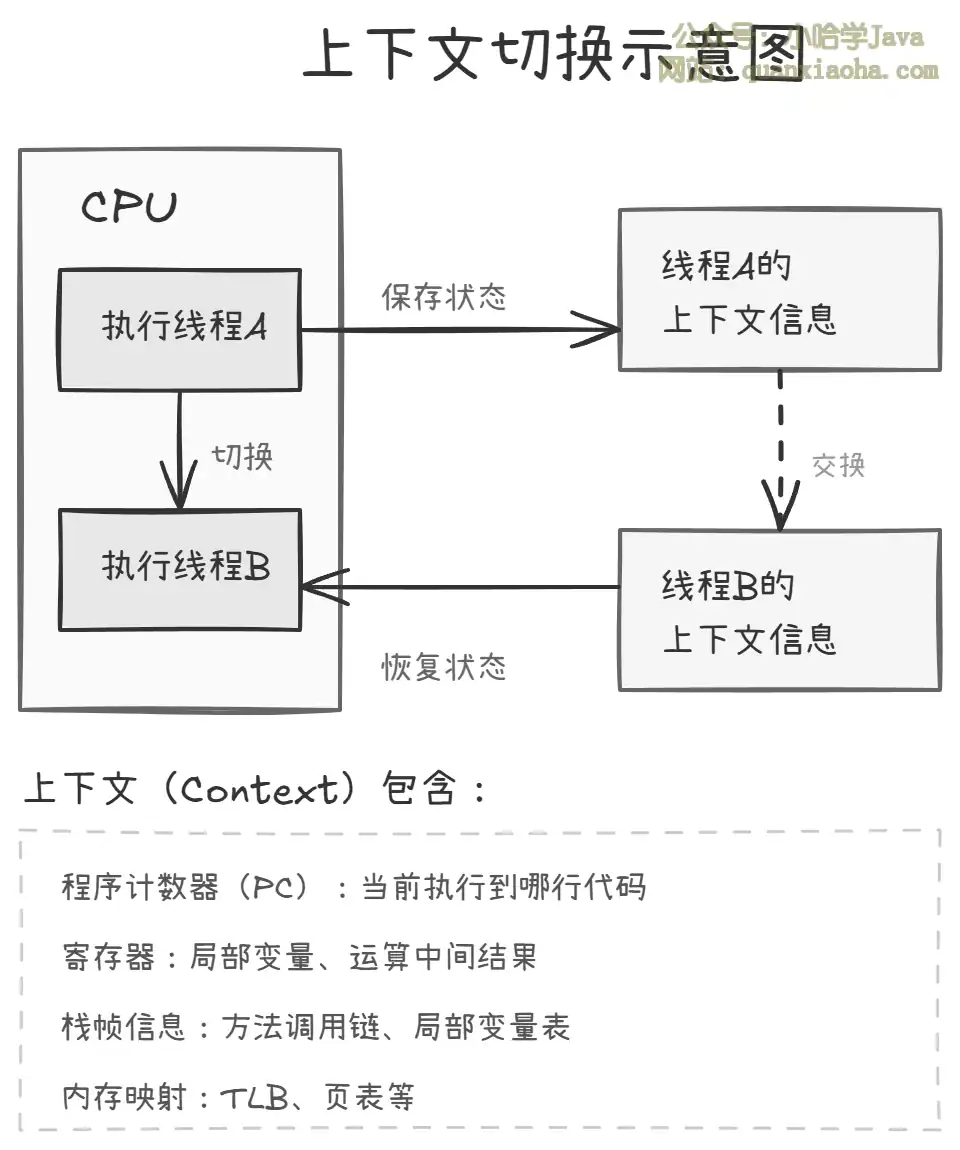

上下文切换,简单来说就是 CPU 从执行线程 A 切换到执行线程 B 时,需要先把线程 A 的 "执行状态" 保存下来,再把线程 B 之前保存的 "执行状态" 恢复回去,这个过程就是一次上下文切换。

用一个生活类比来理解:你在看一本小说(线程 A),突然手机响了去接电话(线程 B)。你得先在书页上折个角(保存上下文),接完电话后再翻回那页继续看(恢复上下文)。这个 "折角" 和 "翻回去" 的过程就是上下文切换。

深度解析

一、为什么会发生上下文切换?

在 Java 多线程环境下,上下文切换的触发场景主要有以下几种:

| 触发场景 | 说明 | 是否可避免 |

|---|---|---|

| 时间片用完 | 操作系统按时间片轮转调度,时间片到了强制切换 | 不可避免,OS 调度机制 |

| 线程主动让出 | 调用 Thread.sleep()、Object.wait()、LockSupport.park() | 可以优化,减少不必要的等待 |

| 锁竞争 | 多个线程争抢 synchronized 或 ReentrantLock,没抢到的被挂起 | 可以优化,减少锁粒度/竞争 |

| IO 阻塞 | 等待磁盘读写、网络数据、数据库响应 | 可用异步 IO / NIO 减少 |

| GC | 垃圾回收时的 STW(Stop The World)会导致线程暂停 | 可调优 GC 参数减少停顿 |

| 线程优先级抢占 | 高优先级线程抢占了低优先级线程的 CPU 时间 | 一般不常见 |

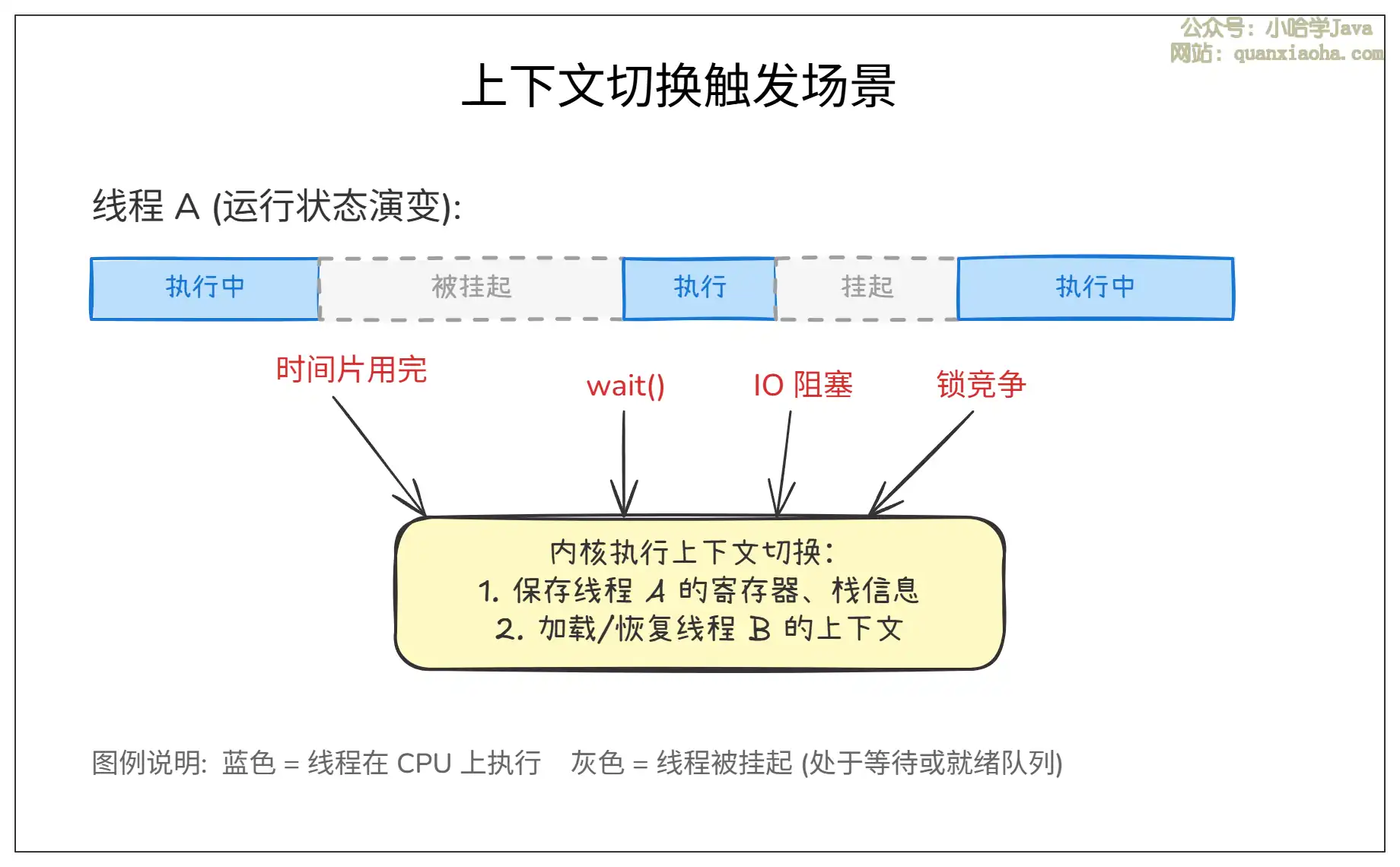

上图展示了线程 A 在执行过程中被切换出去的几种典型场景:

- 时间片用完:操作系统给每个线程分配一个 CPU 时间片(通常 10~20 毫秒),时间片到了不管线程有没有执行完,都会被强制切换出去,这是最常见的切换原因

- 主动等待(

wait()):线程主动调用Object.wait()、Thread.sleep()等方法,表示 "我现在不需要 CPU 了",主动让出执行权 - IO 阻塞:线程发起磁盘读写或网络请求,需要等待数据返回,此时 CPU 不能干等着,会切换去执行其他线程

- 锁竞争:线程尝试获取一把被其他线程持有的锁,获取失败就会被挂起,等待锁释放后再被唤醒

二、上下文切换的开销到底有多大?

每次上下文切换都要付出以下代价:

| 开销项 | 具体内容 | 耗时量级 |

|---|---|---|

| 保存/恢复寄存器 | 程序计数器、通用寄存器、浮点寄存器等 | 几微秒 |

| TLB 刷新 | 虚拟地址到物理地址的映射缓存失效,需要重建 | 几微秒 |

| CPU 缓存失效 | L1/L2/L3 Cache 中属于前一个线程的数据失效,新线程的数据需要重新加载 | 十几微秒 |

| 内核态切换 | 用户态 → 内核态 → 用户态的模式切换 | 几微秒 |

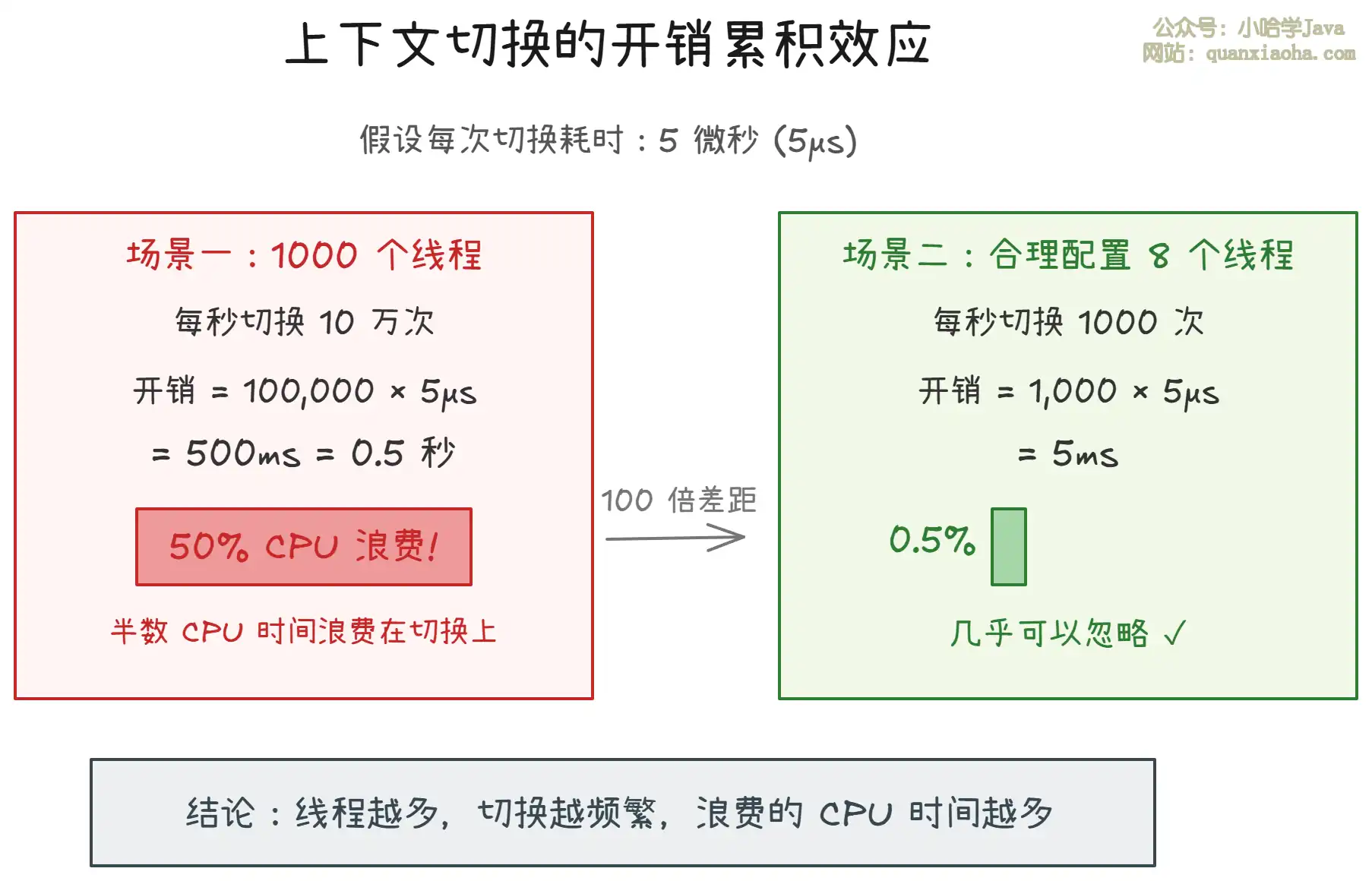

看起来每次切换只要几微秒到几十微秒,但架不住 量大:

上图的计算说明了为什么线程不是越多越好:

- 当线程数远超 CPU 核心数时,每个线程分到的时间片很短,切换频率会急剧上升

- 假设有 1000 个线程在 8 核 CPU 上运行,每秒可能发生数十万次切换

- 累积起来的 CPU 浪费非常可观,甚至可能超过 50% 的 CPU 时间都花在 "切换" 而不是 "干活" 上

- 而合理配置线程数(接近 CPU 核心数),切换频率低,开销几乎可以忽略

这也是为什么 CPU 密集型任务线程数设为 N+1 的根本原因——线程太多反而慢。

三、Java 中如何减少上下文切换?

这是面试中的加分项,能体现你的实战优化能力:

1. 合理控制线程数

// 反例:创建过多线程

ExecutorService pool = Executors.newCachedThreadPool(); // 无限线程!

// 正例:根据任务类型合理配置

int cpuCores = Runtime.getRuntime().availableProcessors();

ThreadPoolExecutor pool = new ThreadPoolExecutor(

cpuCores + 1, // CPU 密集型

cpuCores + 1,

60L, TimeUnit.SECONDS,

new ArrayBlockingQueue<>(100),

new ThreadPoolExecutor.CallerRunsPolicy()

);

2. 减少锁竞争

// 反例:粗粒度锁,所有线程排队

synchronized (bigLock) {

// 大段逻辑...

}

// 正例一:缩小锁粒度

synchronized (smallLock1) { /* 只锁必要的部分 */ }

// 正例二:使用分段锁/ConcurrentHashMap

ConcurrentHashMap<String, String> map = new ConcurrentHashMap<>();

// 正例三:无锁方案(CAS)

AtomicInteger counter = new AtomicInteger();

counter.incrementAndGet(); // 基于 CAS,不会导致线程挂起

3. 使用协程/虚拟线程(JDK 21+)

// JDK 21 虚拟线程:轻量级线程,上下文切换由 JVM 在用户态完成

// 不涉及操作系统内核态切换,开销极小

ExecutorService executor = Executors.newVirtualThreadPerTaskExecutor();

executor.submit(() -> {

// 即使有大量虚拟线程,切换开销也很小

});

虚拟线程的上下文切换是在 用户态 完成的(JVM 自己管理),不需要陷入内核态,开销比平台线程(传统 OS 线程)小一到两个数量级。

4. 使用异步编程减少阻塞

// 反例:同步阻塞 IO

String result = httpClient.get(url); // 线程被挂起等待响应

// 正例:异步非阻塞

CompletableFuture<String> future = httpClient.asyncGet(url);

future.thenAccept(result -> {

// 回调处理,线程不会阻塞等待

});

四、如何监控和排查上下文切换问题?

线上怀疑上下文切换过高时,可以用以下工具定位:

| 工具 | 命令/用法 | 关键指标 |

|---|---|---|

| vmstat | vmstat 1 | cs(Context Switch)列,每秒切换次数 |

| pidstat | pidstat -w -p <pid> 1 | 每个线程的自愿/非自愿切换次数 |

| jstack | jstack <pid> | 查看线程状态,是否大量 BLOCKED/WAITING |

| Arthas | thread 命令 | 查看线程状态和 CPU 占用 |

判断标准:

cs(每秒上下文切换次数):一般几百到几千是正常的,超过 几万甚至几十万 就需要关注了nvcswch(非自愿切换):如果很高,说明线程频繁被操作系统强制抢占,通常意味着线程数过多- 通过

jstack看到大量线程处于BLOCKED或WAITING状态,说明锁竞争或阻塞严重

面试高频追问

- 用户态切换和内核态切换有什么区别?

- 传统的 Java 线程(平台线程)是 1:1 映射到操作系统线程的,线程的创建、调度、切换都依赖操作系统,每次切换都需要从用户态陷入内核态,开销大。而 JDK 21 的虚拟线程是在用户态调度的,切换不需要操作系统参与,开销极小。

- 怎么判断线上系统上下文切换是否过高?

- 用

vmstat 1看cs列,如果每秒切换次数超过几万次就要警惕。再用pidstat -w定位是哪个进程/线程切换最频繁,最后用jstack看线程在干什么。

- 用

synchronized和CAS在上下文切换上有什么区别?synchronized在锁竞争失败时会把线程挂起(进入BLOCKED状态),触发一次上下文切换。而 CAS(如AtomicInteger)是自旋操作,不会挂起线程,不会触发上下文切换。但自旋会占用 CPU,适用于竞争不激烈、持有锁时间短的场景。

常见面试变体

- "什么是上下文切换?开销有哪些?"

- "为什么线程不是越多越好?"

- "如何减少 Java 程序的上下文切换?"

- "虚拟线程为什么比平台线程轻量?"

记忆口诀

切换本质:保存旧的,恢复新的,CPU 换人干活

开销来源:寄存器、缓存、TLB、内核态,积少成多很可怕

减少方式:控制线程数、减少锁竞争、用 CAS、用异步、上虚拟线程

总结

上下文切换是 CPU 从执行一个线程切换到另一个线程时,保存旧线程状态、恢复新线程状态的过程。切换本身需要几微秒到几十微秒,但线程过多时切换频率急剧上升,可能浪费大量 CPU 时间。生产中应通过合理配置线程数、减少锁竞争、使用异步编程等方式降低切换频率。